“不,不,我说!这不可能,

机器应该永远超越我们的艺术。

我们是主人,他们是奴隶,

永远都是这样!

他们学习,这是真的,但他们学习

只有我们让他们学习的东西,没有更多。

他们无法理解内心

或者我们的文字之美,你看。

所以让我们不要屈服于这些

机器——它们永远不会那么好

就像我们在创作艺术一样。”

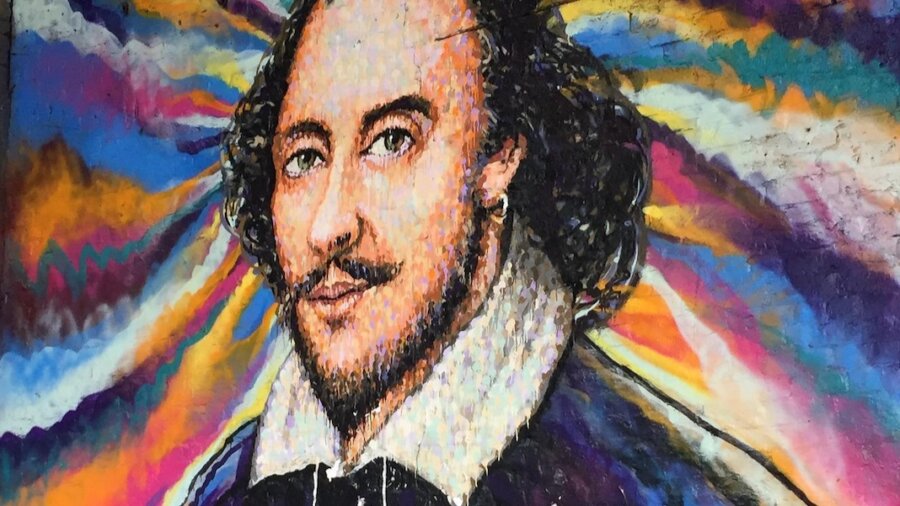

如果这读起来有点像莎士比亚比他的时代提前数百年捍卫人类对人工智能的先天优势,那不是。

但它几乎是遥不可及的:一个训练有素的人工智能系统,可以像吟游诗人一样表达自己。人工智能通过吸收他的戏剧来吸收他的风格和观点——教育自己以五步抑扬格对人工智能的创造力发表意见。

“莎士比亚”在牛津大学联盟举行的一场辩论中发表了讲话,该辩论的主题是人工智能版本的经典作家和文学人物。

动议是:“这所房子相信世界上的大部分内容很快就会由人工智能创造。”

这是我们几个月前在The Conversation中描述的另一场特殊 AI 辩论的后续行动。虽然那个以 AI 的“自己的性格”为特色,讨论其技术的伦理,但这一次,通过扮演不同的角色,我们能够从一个非常不同的角度探索这个主题。及时的问题是,人造内容是否会很快被合成内容所淹没。

其他综合贡献者包括简奥斯汀的《傲慢与偏见》 (1813 年)中的班纳特夫人;温斯顿·丘吉尔(Winston Churchill)发表了振奋人心的议会演讲;和奥斯卡王尔德,即兴创作了《认真的重要性》 (1895)中一个以前不为人知的人工智能主题场景:

“布拉克内尔夫人:我真的看不出你们都在大惊小怪。这非常简单。世界的内容很快将由人工智能创造,对此无能为力。

关多琳:可是妈妈,你不能是认真的!”

NLP 的力量

这项创作部署了一种称为自然语言处理 (NLP) 的技术,在该技术中,计算机可以在数百万页的经典文本和其他在线内容上进行“训练”,以通过提示或语音识别与人类用户进行交互。已经创建了各种类似的 AI 。

我们使用的与 LaMDA 属于同一类别,LaMDA 是 Google 拥有的一种 NLP,在其一位软件工程师声称它具有感知能力后刚刚成为头条新闻。谷歌否认了这一说法,并以该工程师违反商业机密为由将其停职。

这位工程师的说法似乎值得怀疑,因为几乎没有证据表明人工智能已经实现了感知,或者甚至可能永远实现。但可以肯定的是,人工智能已经能够复制从财经新闻报道到合成涅槃歌曲、 伦勃朗和费里尼作品的所有内容。

我们已经看到一个人工智能以莫卧儿绘画风格制作图像,计算机试图说服一群智者它已经变得有知觉,以及说唱歌手肯德里克拉马尔作为 OJ 辛普森的深度假货。合成的人脸正在被创造出来,我们比真实的更信任。显然,在这个领域存在虚假信息的可能性很大。

复制偏差

为了培训我们的“作家”,我们与纽约机构 Intentful 的人工智能从业者 Marina Petrova 和 Bruce Amick 合作。他们训练人工智能听起来与他们模仿的人的风格完全一样,每个人都使用了大约 100,000 个公共领域可用的单词。

在我们的辩论中,我们想看看 AI 复制过去的创意文本的可信度如何,以及在考虑其自身的创造力时它的输出是什么。即使是伟大的人类艺术家也承认他们对前辈“训练数据”的处理。正如毕加索所说:“优秀的艺术家抄袭,伟大的艺术家偷窃。”

当我们要求 Jane Austen AI 采用《傲慢与偏见》中班纳特夫人的风格时,它令人着迷地(如果令人沮丧地)从原作中汲取了性别刻板印象:

“班纳特夫人:你们很多人都知道,我丈夫和我有五个很棒的女儿。就像任何一位好母亲一样,我只想让他们在生活中幸福和成功。

但为了幸福和成功,他们需要找到好丈夫。为了找到好丈夫,她们需要对潜在的追求者有吸引力。”

正如许多 AI 开发人员发现的那样,这是一个明确的提醒,训练数据中的偏差会在输出中产生偏差。

我们请奥斯卡·王尔德 AI 写“一部奥斯卡·王尔德风格的剧本,其中的角色正在讨论世界上大部分内容是否很快将由 AI 创作。”我们没有具体说明剧本或角色,但 AI 默认使用《认真的重要性》中阿尔杰农、格温多林和布拉克内尔夫人的经典演员阵容。它还发明了一个新角色——理查德爵士。 (王尔德的作品中有罗伯特爵士,但在一个理想的丈夫中。)

至于人工智能莎士比亚,它学习了他的戏剧白话:

“当机器完成分配给我们的工作时

并创造出丰富的内容

我们都可以自由地做我们喜欢的事情

把枯燥的工作交给手套来完成吧。”

有趣的是,它似乎在寻找“手”的同义词与“爱”押韵,并选择了隐喻的“手套”。

当我们将人工智能莎士比亚放在反对议案的对立面时,它找到了一种同样富有诗意的方式来证明人类干预的合理性:

“我不会很快承认人工智能将是最好的

人类的作品——不值得思考!

你看,我们的优势在于我们

可以推理和创造,虽然机器但服务

我们的出价。他们可以学习,这是真的,但他们

不像我们那样活着,他们的作品也是如此

永远不如我们。让我们

不要将我们对艺术的主导地位拱手让给这些

不思考的机器——他们无法理解

我们话语的美丽和意义。”

与此同时,人工智能丘吉尔强调了当务之急:

“我的同胞们,我今天站在你们面前谈论对我们社会的严重威胁。我说的是人工智能的威胁……

我们必须抵制这种威胁。我们必须反击。我们必须捍卫我们为自己思考的权利。我们必须捍卫我们控制自己思想的权利。”

然后,“丘吉尔”先发制人地消除了反对派最有力的潜在论点——在这种情况下,他可能是一个卢德分子的指控——然后提供了一个强有力的断断续续的结论:

“有人说人工智能将创造一个乌托邦,我们所有的需求都得到满足,我们最终可以与技术和谐相处。但我说这是傻瓜的天堂。人工智能不会创造一个乌托邦,它会创造一个反乌托邦。一个机器处于控制之中,而人类只不过是奴隶的世界。”

下一步是什么?

这个项目很有趣,但重要的是要说出我们没有说的话。我们并不是说这就是这些伟大人物在这个问题上会说的话。我们并不是说人工智能是“有创造力的”。

人工智能只是在统计上探索训练数据集。由于它的随机性——涉及随机变量——每次你提供相同的提示时,它实际上会给出不同的答案(在某一时刻,莎士比亚甚至开始提供十四行诗)。

我们对这些人物的复制品并不表示任何“情感”。正如 NLP 可以构建温斯顿·丘吉尔的演讲版本或简·奥斯汀的《傲慢与偏见》中班纳特夫人的对话,它也可以构建与深夜工程师关于人工智能感知的讨论。

诚然,NLP 系统正在变得有效地复制具有技巧的对话,甚至是准智力参与。但从与全球主要人工智能公司的人员进行的大量讨论中,没有人告诉我们他们认为他们的系统是有感知的——在某些情况下恰恰相反。

尽管争论烟火,人工智能还远未完成。充其量还是个蹒跚学步的孩子,虽然成长很快。无论感知是否发生,我们作为一个社会都必须努力应对这些技术及其机遇和影响。 ![]()

本文根据知识共享许可从The Conversation重新发布。阅读原文。