曾经有一段时间,将一张旧照片转换为数码图像给人们留下了深刻的印象。这些天我们可以做更多的事情,比如像哈利波特那样将复古照片带入生活。本周,芯片制造商英伟达又上演了一个魔术。

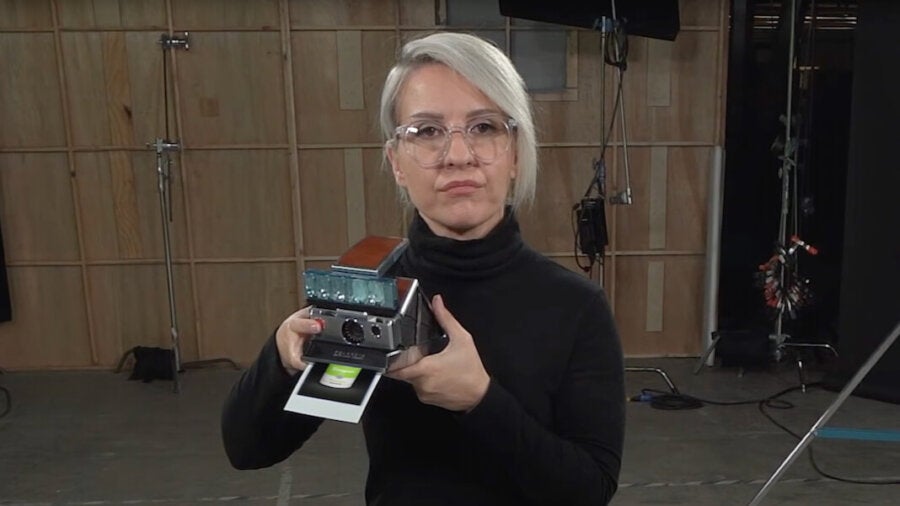

在之前的工作的基础上,NVIDIA 研究人员展示了一个在几十张图像上训练的小型神经网络如何以全 3D 形式渲染所描绘的场景。作为演示,该团队将模特手持宝丽来相机的图像(对安迪沃霍尔的颂歌)转换为 3D 场景。

这项工作之所以脱颖而出,有几个原因。

首先,它非常快。早期的 AI 模型需要数小时的训练时间和数分钟的时间来渲染 3D 场景。 NVIDIA 的神经网络只需几分钟即可训练并在几十毫秒内渲染场景。其次,与当今庞大的语言模型相比,人工智能本身是微不足道的。像 GPT-3 这样的大型模型在数百或数千个图形处理单元 (GPU) 上进行训练。 NVIDIA 的图像渲染 AI 在单个 GPU 上运行。

这项工作建立在神经辐射场(NeRFs) 的基础上,这是几年前加州大学伯克利分校、加州大学圣地亚哥分校和谷歌研究院的研究人员开发的一项技术。简而言之,NeRF 获取有限的数据集(例如,从不同角度拍摄的 36 张主体照片),然后预测从场景中任何点辐射的光的颜色、强度和方向。也就是说,神经网络根据训练数据以最佳猜测填补图像之间的空白。结果是从原始图像拼接在一起的连续 3D 空间。

NVIDIA在一篇论文中概述了最近的贡献,将 NeRFs 用于性能增强药物。根据该论文,被称为 Instant NeRF 的新方法利用一种称为多分辨率哈希网格编码的方法来简化算法的架构并在 GPU 上并行运行。这将性能提高了几个数量级——根据NVIDIA 的一篇博客文章,他们的算法运行速度提高了 1,000 倍——而不会牺牲质量。

NVIDIA 认为这项技术可以应用于机器人和自动驾驶汽车,帮助他们更好地可视化和了解周围的世界。它还可以用于制作人们可以导入虚拟世界的高保真化身,或者在数字世界中复制现实世界的场景,设计师可以在其中修改和构建它们。

在这种情况下,神经网络的速度和规模很重要,因为大多数人无法使用需要大量计算能力的巨大算法,对于没有闪电般快速、可靠的云连接的机器人和汽车来说,它们也不实用。

该演示是本周 NVIDIA 开发者大会的一部分。其他亮点包括一个自动驾驶汽车系统,该系统旨在到 2024 年将 300,000 英里的道路绘制成厘米,以及该公司表示将在发布后成为世界上最快的人工智能超级计算机( Meta 最近也提出了这一说法)。

所有这一切都恰如其分地融入了一个更大的叙述中。数字世界正在渗入现实世界,反之亦然。不仅仅是书籍、音乐、照片、文件和支付——还有人、地方和基础设施。鉴于 NVIDIA 的芯片在 AI 和图形方面表现出色,该公司完全有能力参与其中。事实上,该公司并不满足于创建单个场景的数字复制品,而是表示它也在构建地球的数字双胞胎。

诚然,在营销和销售宣传与重大发展之间划清界限变得越来越困难。在一个标题中看到所有科技热门词汇(NFT、元界、人工智能、区块链)的混搭并不少见。但是,虽然视觉似乎超过了能力,但有很多暗示我们迟早会到达那里。

可以将一堆宝丽来变成 3D 场景的迷你 AI 就是其中之一。

图片来源: 英伟达