当谷歌宣布其量子计算机解决了最强大的超级计算机无法解决的问题时,这对行业来说是一个里程碑。但中国研究人员现在已经证明,他们可以在几秒钟内在普通超级计算机上解决同样的问题。

量子计算的最终承诺是它能够比经典机器更快地执行某些计算壮举,甚至解决使用传统方法基本上不可能破解的问题。

不过,该领域仍处于起步阶段,如今的设备太小,无法应对任何现实世界的挑战。但为了证明该领域正在取得进展,量子处理器的开发人员一直渴望找到可能没有太多实际用途的问题,但可以证明他们的技术能够实现潜在的加速。

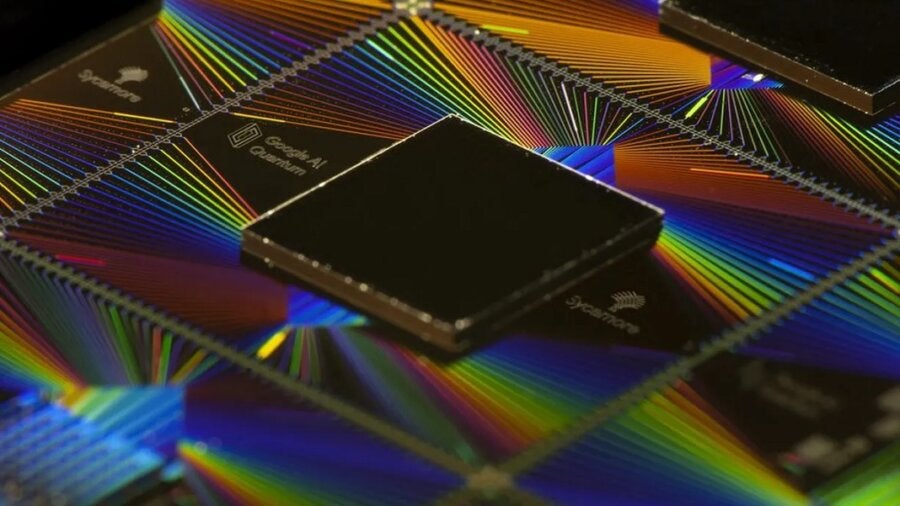

谷歌在 2019 年在这方面取得了重大突破,当时它声称其Sycamore 处理器已经解决了一个超级计算机在 200 秒内需要 10,000 年的问题。这个问题对他们有利,因为它本质上涉及模拟他们的处理器的输出,但通过展示经典计算机将难以解决,他们能够声称“量子霸权”,今天更普遍地称为“量子优势”。

但现在中国的研究人员使用一些巧妙的算法设计和一台中等大小的计算机在短短 15 小时内解决了同样的问题。根据他们的计算,如果他们能够使用全尺寸的超级计算机,只需要几十秒。

谷歌设定的挑战是模拟其处理器或多或少地充当随机数生成器。唯一的区别是他们重复了数百万次算法,并且由于算法的性质,某种模式应该出现在被吐出的随机数中。

随着处理器尺寸的增加,在经典计算机上进行模拟应该很快就会变得困难,因为编码的信息量会随着每个额外的量子比特呈指数增长。使用传统方法来解决这个问题,谷歌预测需要 10,000 年才能模拟其 53 量子位处理器。

中科院理论物理研究所的团队通过对用于解决问题的基础数学进行重新设计,获得了这一轮。他们将处理器表示为称为张量的数学对象的 3D 网络,表示 53 个量子位之间的逻辑门。该网络重复了 20 层,旨在表示量子算法在读取处理器输出之前运行的 20 个周期。

使用张量的优势在于,推动深度学习革命的芯片 GPU 能够非常快速地并行处理它们。研究人员还利用了谷歌对 Sycamore 的计算不是很精确的事实,达到了只有 0.2% 的保真度。这使他们能够牺牲模拟的一些准确性来提高其速度,他们通过消除量子位之间的一些连接来做到这一点。

结果是,他们设法在 512 个 GPU 上在短短 15 小时内将 Sycamore 处理器的输出模拟到 0.37% 的保真度——比大多数领先的超级计算机的处理能力要低得多。一篇概述结果的论文目前正在Physical Review Letters上发表,但去年 11 月发布了一份未经同行评审的预印本。

虽然结果确实在一定程度上打破了谷歌的量子霸权泡沫,但该公司在给Science的一封电子邮件中指出,它曾预测经典算法将在其 2019 年的论文中得到改进。但他们补充说,他们认为他们无法长期跟上量子计算机性能的指数增长。

这不是唯一一个被撤销的量子霸权实验。 2020 年,一个中国团队声称,他们的量子计算机可以在 200 秒内解决一个超级计算机需要 25 亿年的问题,但在 1 月份,研究人员表示实际上只需要 73 天。

虽然这并没有否定该领域正在取得的进展,但越来越多的研究人员表示,在这类抽象计算问题上让量子机器和经典机器相互对抗并不能真正清楚地了解该技术的位置。

他们说,真正的考验将是量子计算机能够比经典计算机更快、更有效地解决现实世界的问题。这似乎还有一段路要走。

图片来源:谷歌