今天早上,谷歌发布了重大公告:推出 Gemini 2.0:我们面向代理时代的新人工智能模型。里面有很多东西(包括Project Astra和新的Project Mariner的更新),但最有趣的是我们今天可以开始使用的东西,它们是围绕全新的Gemini 2.0 Flash模型构建的。 开发者博客文章提供了更多技术细节。

Gemini 2.0 Flash 是多模式法学硕士。谷歌声称它比 Gemini 1.5 Pro(他们之前最好的型号)功能更强大,速度也快两倍。

新的Flash可以处理与Gemini 1.5系列相同的全方位多模式输入:图像、视频、音频和文档。与 1.5 系列不同,它还可以以多种方式输出 – 除了文本之外,还有图像和音频。图像和音频输出尚未普遍提供,但应该会在明年初推出。

它还引入了令人印象深刻的流媒体功能。稍后将在本文中详细介绍这一点。

让我们首先尝试将其作为多模式输入、文本输出模型。

使用 llm-gemini 运行视觉提示;

我发布了llm-gemini 0.7,向我的LLM命令行工具添加了对新模型的支持。您需要一个 Gemini API 密钥– 然后安装 LLM并运行:

llm install -U llm-gemini llm 键设置双子座 # ...在此处粘贴 API 密钥 llm -m gemini-2.0-flash-exp 描述 \ -a https://static.simonwillison.net/static/2024/pelicans.jpg

它使用我的pelicans.jpg图像作为输入,这是一张低分辨率照片,显示的是岩石露头上一大群令人困惑的鹈鹕。这是探索模型视觉功能的良好起点。

完整的文字记录在这里。这是我见过的最好的结果之一:

整体场景:

该图像描绘了一大群鹈鹕和其他鸟类紧密地聚集在岩石露头上。鸟儿密密麻麻,许多鸟儿重叠在一起,几乎融为一体。他们身后是一片水域,远处可以看到黑暗的海岸线或悬崖。该场景似乎是在阳光明媚的日子拍摄的,光线充足,照亮了鸟类。

鸟类:

- 鹈鹕:最著名的鸟类是褐鹈鹕,其特点是体型庞大、灰棕色、长喙和突出的喉袋。有些鹈鹕的头上有白色,表明其中一些是年长的鸟类。他们摆出各种姿势,有的直立着,有的在打扮或互动。它们位于岩石的中部和上部。

- 较小的鸟类:还有许多较小、颜色较深的鸟类,可能是鸬鹚或海鸥,散布在整个场景中。它们经常被发现更接近地面。它们的外观似乎都很相似,都有深色的羽毛和短喙。它们与鹈鹕混在一起或在鹈鹕周围。

- 排列:鸟儿聚集在一起。它们位于岩石顶部,这表明它们正在利用岩石露头作为休息的地方。这是一个拥挤的场景。

环境:

- 岩石:鸟儿在浅色、粗糙的岩石表面上休息。它似乎是一个自然露头,具有各种纹理的表面。岩石构成了这幅画的基础。

- 水:背景中有一片黑暗的水体,可能是大海或大湖。水面大多平静,给场景增添了平静的感觉。

- 背景:远处的背景似乎有岩石海岸或悬崖面。背景与浅色岩石表面和鸟类形成鲜明对比。背景是深色的,几乎是纯色的。

灯光和颜色:

- 光线:照片中的光线自然、明亮,并提供了鸟类羽毛的大量细节。它似乎来自头顶,并且只有极少的刺眼阴影。

- 颜色:调色板主要是泥土色调。鹈鹕有棕色、灰色和白色的变化。较小的鸟类呈深灰色和棕色。岩石是浅灰色,几乎是白色,背景是深灰色。

总体印象:

总体印象是一个繁忙的自然栖息地,各种鸟类聚集在一起。该图像捕捉到了不同鸟类的野性和共存。尽管动物数量众多,但场景却给人一种平和、安宁的感觉。

加州褐鹈鹕的白色头部正在繁殖羽毛,这确实表明它们是老鸟。

在边界框上的表现令人印象深刻

Gemini 1.5 系列最有趣的特性之一是它能够返回图像内对象的边界框。我在 8 月份的《构建一个展示 Gemini Pro 如何返回图像中对象的边界框的工具》中描述了我为探索这一点而构建的工具。

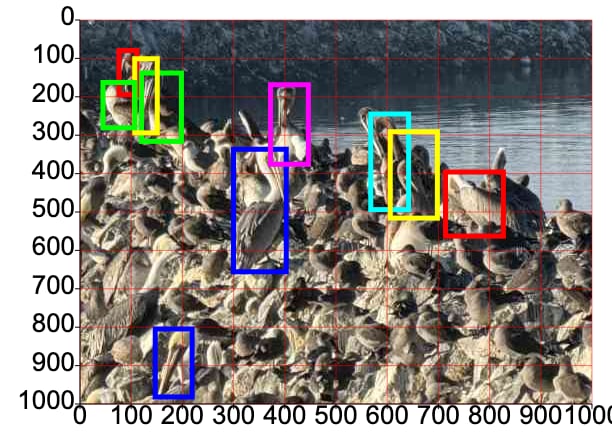

我升级了该工具以支持 Gemini 2.0 Flash 并运行了我的鹈鹕照片,并出现以下提示:

Return bounding boxes around all pelicans as JSON arrays [ymin, xmin, ymax, xmax]

这是我得到的结果,通过我的工具覆盖在图像上:

考虑到这张照片的复杂程度,我认为这是一个非常惊人的结果。

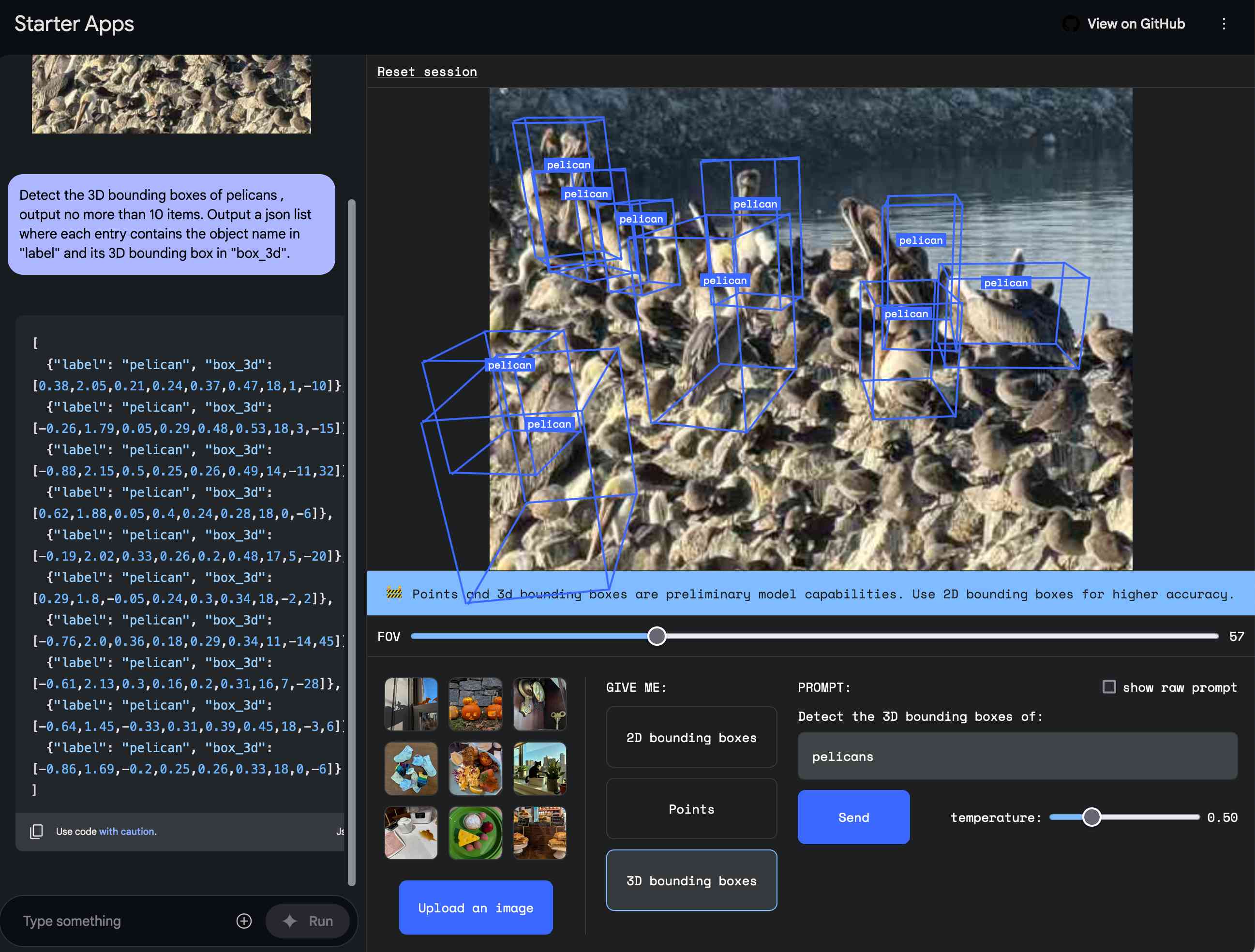

AI Studio 现在提供了自己的空间理解演示应用程序,可用于尝试模型的这方面,包括返回“3D 边界框”的能力,我仍然没有完全理解!

谷歌发布了一段有关Gemini 2.0 空间理解的 YouTube 短视频。

它既可以编写代码也可以执行代码

Gemini 1.5 Pro 模型也具有此功能:您可以要求 API 启用代码执行模式,该模式允许模型编写 Python 代码、运行它并将结果视为其响应的一部分。

以下是如何使用 LLM 以及-o code_execution 1标志来访问它:

llm -m gemini-2.0-flash-exp -o code_execution 1 \

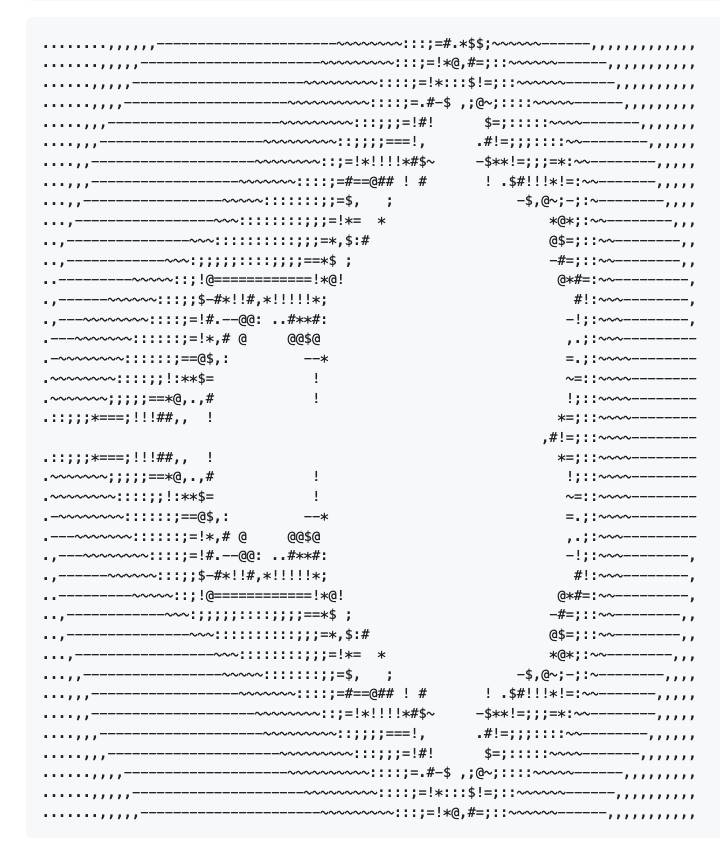

'编写并执行 python 生成 80x40 ascii 艺术分形'

完整的回复在这里– 这是它为我绘制的内容:

代码环境无权进行出站网络调用。我试过这个:

llm -m gemini-2.0-flash-exp -o code_execution 1 \

'编写 python 代码来检索 https://simonwillison.net/ 并使用正则表达式提取标题,运行该代码'

该模型尝试使用requests ,意识到它没有安装它,然后尝试urllib.request并收到Temporary failure in name resolution 。

有趣的是它并不知道自己无法访问网络,但又尝试了几次之后就放弃了。

流媒体 API 更上一层楼

Gemini 2.0真正酷的地方是全新的流 API。这使您可以打开向模型发送音频和视频并实时返回文本和音频的双向流。

我强烈建议您立即使用https://aistudio.google.com/live尝试一下。它适用于我笔记本电脑上的 Chrome 和 iPhone 上的 Mobile Safari – 它在 Firefox 中不太适用。

这是我刚刚在手机上运行的一分钟长的视频演示:

API 本身现在就可以试用。我设法通过执行以下操作使multimodal-live-api-web-console演示应用程序正常工作:

- 克隆存储库:

git clone https://github.com/google-gemini/multimodal-live-api-web-console - 安装 NPM 依赖项:

cd multimodal-live-api-web-console && npm install - 编辑

.env文件以添加我的 Gemini API 密钥 - 使用

npm start运行应用程序

它与之前的现场演示非常相似,但有额外的工具 – 因此您可以告诉它渲染图表或运行 Python 代码,它会向您显示输出。

这些东西直接来自科幻小说:能够与有能力的法学硕士进行音频对话,谈论它可以通过你的相机“看到”的事物,这是“我们生活在未来”的时刻之一。

值得注意的是,OpenAI 几个月前在 DevDay 上发布了自己的 WebSocket 流 API,但该 API 只能处理音频,目前使用起来非常昂贵。 Google 尚未公布 Gemini 2.0 Flash 的定价(这是免费预览版),但如果以 Gemini 1.5 系列为依据的话,它的价格可能会低得惊人。

值得期待的事情

我通常不会对尚未发布的功能太兴奋,但本机图像输出视频中的这个东西引起了我的注意:

多模态图像输出的梦想是模型可以比使用前几代基于扩散的图像模型进行更细粒度的图像编辑。 OpenAI 和 Amazon 都承诺在不久的将来推出具有这些功能的模型,因此看起来我们将在 2025 年享受到这些东西带来的乐趣。

The Building with Gemini 2.0:本机音频输出演示视频展示了 Gemini 2.0 Flash 在不同声音、语调、语言和口音的音频输出方面的表现。这看起来与 OpenAI 目前的高级语音模式类似。

标签:谷歌,人工智能,生成人工智能, LLMS , Gemini ,视觉 LLMS

原文: https://simonwillison.net/2024/Dec/11/gemini-2/#atom-everything