“目前的会费:未来来得很快

什么应该为临时辩护?并最终

我们怎么算的?” ——弗拉维乌斯,威廉·莎士比亚的《雅典的丁满》

对于人类的长远未来,我们应该有一些明显的目标,但最被忽视的是确保人类仍然是人类。

当然,这是街上普通人会关心的。然而,许多致力于长期主义的人却忽略了这一点,他们通常是有效的利他主义者、理性主义者或未来主义者(或与这些人相近的其他标签),他们通常专注于确保经济进步、避免生存风险和加速技术,例如生物技术和人工智能——具有讽刺意味的是,正是这些技术可能使我们变得面目全非,并引发我们的清算。事实上,就在上周,大公司推出了两种新的人工智能:谷歌的 PaLM,一种在一系列认知测试中表现优于普通人的通用人工智能,以及 OpenAI 的 DALL-E,一种数字艺术家,它们共同预测了如何人工智能的快速发展将继续显着加速(在预测网站 Metaculus 上,预测的时间线跃升了八年)。因此,未来将比我们想象的更快地降临到我们身上,我们需要开始决定我们现在想要什么样的未来。

长期主义为此提供了一个道德框架:它认为我们应该给予未来生命道德上的重量,也许打折,也许不打折;因为一个人是否打折假设的未来人(相对于真实的人)被证明是无关紧要的。潜在的人比实际的人,甚至是曾经生活过的历史人物要多得多。地球上只有大约 1000 亿人走过,仅在未来 1000 年的历史中,潜在的人数就可能达到数万亿。因此,即使你对它们进行大量折扣,结果仍然是每个可能活着的人的道德价值都超过了现在活着的每个人的道德价值。我觉得这个观点,从广义上讲,是有说服力的。

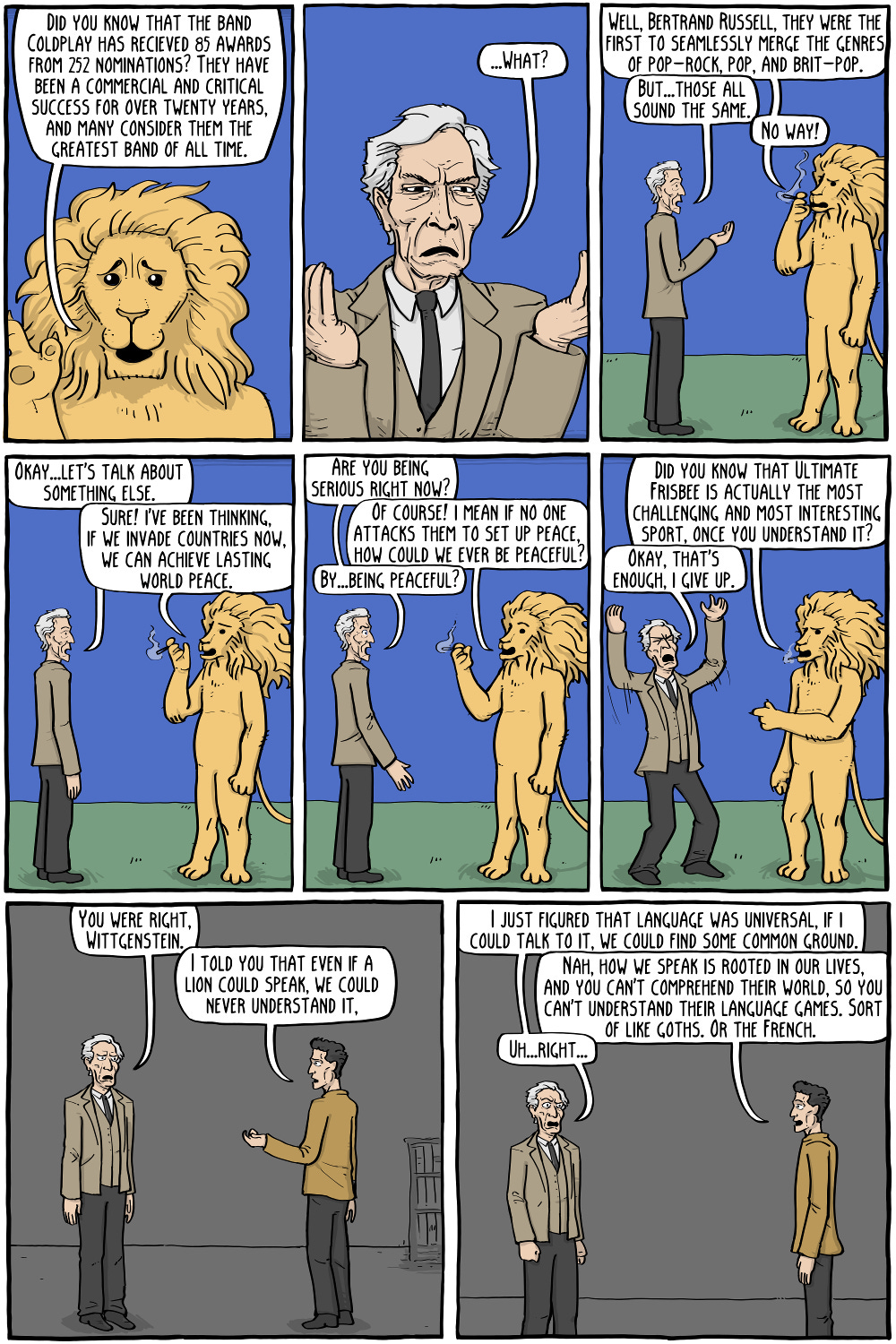

但是,什么才是道德价值肯定会随着时间的推移而变化,并且在未来可能会大不相同。这就是为什么一些长期主义者寻求“面向未来”的道德规范。然而,我们是否应该将道德价值赋予未来取决于我们是否发现它可识别,即未来是否是人的或非人的。这本身就是一个公理化的道德原则,不可简化为长期主义的其他目标。这是不言自明的,因为随着未来文明与基线人类的显着偏离,我们对结果好坏做出判断的能力将变得越来越不确定,直到最终我们当前的道德观点变得不相称。对某个未来主义的全脑行星大脑来说,谋杀个人是什么?可以无限复制自身的数字意识是什么谋杀?什么都不是,连一个喷嚏都没有——这就像把我们的伦理观念应用到狮子身上一样荒谬。就像维特根斯坦关于会说话的狮子是矛盾的例子(因为会说话的狮子对我们人类来说是不可理解的),使用我们当前的人类伦理来回答关于非人类社会的伦理问题是矛盾的。我们对它们没有什么有趣的说法。

人性是一种与生俱来的道德品质,超越了幸福或快乐——这就是为什么美丽新世界是一个反乌托邦,尽管每个人都因吸毒而过分快乐,但他们却被剥夺了人际关系和人性化的方式的生活。这就是为什么灵长类动物的痛苦总是比头足类动物的痛苦更能打动我们,因为接近我们自己的生活方式会增加同情(这是正确的——例如,章鱼是食人动物,而母亲必须进入一个预先就在他们的孩子出生之前,程序化的生物死亡螺旋,所以他们不会在可怕的盛宴中吃掉他们)。

如果你想最深刻地感受人性的道德价值,就去庞贝看看石膏像手牵手,拥抱,母亲在最后时刻庇护孩子。在那里,在地中海不可思议的蓝天和环绕城市破碎墓地的山区天际线中,您会感受到它。庞贝人民的人性就是为什么我们觉得他们的死如此有意义、如此有影响力,因为他们带着幽默的涂鸦、选举候选人海报的碎片、他们的凳子、沙发、花园、体育馆和他们的瓷砖入口处写着CAVE CANEM (小心狗)——我们几乎可以闻到大蒜的味道,听到孩子们的笑声和火山的隆隆声。走在庞贝城,你会发现我们和他们之间有一条线,一条不能切断的线。

因此,在某些方面,保持人类人性应该是长期主义的核心支柱,就像最大限度地减少生存风险(地球在未来被毁灭的可能性)一样,既因为人类作为人类与生俱来的道德价值,也因为非人类未来我们无论如何都不能做出道德判断。

虽然在这里我应该承认,什么才是“人”是非常主观的。对于(稍微)更客观的定义,让我们转向人类最伟大的编年史家:威廉莎士比亚。

当卡尔·萨根(Carl Sagan)主持由美国宇航局(NASA)召集的艺术家和科学家委员会决定航海者号宇宙飞船的金唱片应该播放什么音乐时,一位成员显然说我们应该发送“巴赫,所有的巴赫!”致任何发现该记录的未来外星文明。然后,在停顿之后,委员会成员说:“没关系,我们会吹牛的。”这就是人们对莎士比亚作品的感受;把莎士比亚送到外星人那里是在吹嘘自己是人类。

所以我们可以依靠吟游诗人,对于任何假设的未来,应用“莎士比亚测试”,它要求:

莎士比亚的作品还有哪些方面反映在未来的文明中?反过来说,未来的文明还能欣赏莎士比亚的作品吗?

因为我们中的任何一个人都想生活在一个莎士比亚已经过时的世界吗?想象一下这意味着什么——人们、家庭、父母和孩子、人际关系、爱人和敌人的动态,所有这些东西,一定会变得如此不相称,以至于吟游诗人再也没有什么可说的了。这是一个恐怖。这就像晚上把婴儿留在婴儿床里,早上发现它变成了某种难以形容的呜咽生物。仍然有生命,是的,但它是不相称的,那是一种恐怖。

为了了解如何应用莎士比亚测试,让我们考虑四种可能的未来,每一种都代表着人类在历史大局中可能采取的特定路径。当我们这样做时,让每条路径都有一个傀儡。那么我们可以把人类的长远未来想象成弗里德里希·尼采、艾伦·图灵、皮埃尔·泰尔哈德·德·夏尔丹和威廉·莎士比亚之间的肮脏斗争。在这四个中,只有莎士比亚的作品让我觉得并不可怕。

威廉目前处于不利地位,但在战斗中,他斗志旺盛,秃顶,而且可能有点醉了。我不会和他打赌。

“如果你的每一个愿望都有一个子宫,每一个愿望都可以生育,一百万”——占卜师、安东尼和克娄巴特拉

尼采式的未来

有其明显的吸引力,而其危险则更为隐蔽。未来由名称所暗示的内容组成: Übermensch 。如果我们想象重要的基因编辑变得普遍,我们可能首先简单地想象设计婴儿,看起来很没有威胁的小生物,只是强壮而快乐的生物,拥有完美的牙齿和美丽的眼睛。因此,让我们把他们培养成设计师,他们富有的父母选择了专门针对运动能力、竞争力、智商和领导力的基因,以及所需的任何多基因特征。他们看起来很像希腊诸神。他们会进入他们想要的任何大学,他们永远不会生病,他们会跑得更快,思考得更深入,他们会更加努力。他们将是华丽和鞭子聪明的。但是,就像希腊诸神一样,他们将是一群脾气暴躁、种族主义、反社会的超级掠夺者,在床上很好,但在关系中很糟糕。因为受追捧的设计师特质可能只会带来直接的自私利益,而对其基因优势的了解可能会滋生傲慢和蔑视。

我当然不是第一个指出这一点的人。的确,这是科幻小说的比喻,但让我们在争论的基础上加点严谨。在传统的亲属选择观点中,促进利他主义的基因在人群中是否成功取决于不等式rb > c。这是一个简单的方程,其中r是利他行为所针对的其他个体的遗传相关性, b是其他个体的利益, c是表达利他行为的原始有机体的成本。然而,也存在群体选择的可能性,其中利他个体群体,即使不相关,也可以胜过非利他者群体。因此,有些人认为该等式应该更通用: rb + Be > c。在这个等式中,收益被分成两部分:原始的rb ,通过亲属关系产生的基本收益,以及Be ,超过亲属收益的整体收益。正如 EO Wilson 1所说:

“在一个群体中,自私的人打败了利他的人。但是,一群利他的人打败了一群自私的人。”

在基因编辑中,对群体的好处将被忽略,因为如果你能设计自己的后代,没有人愿意吃额外的成本。当然,人们不会这样想,但每次他们选择最大化智力而不是同理心,或者运动能力而不是勇敢,或者性感而不是情感温暖,这就是将会发生的事情。就好像人类摆脱了他们所经历的所有群体层面的选择。这并不意味着我们不能使用基因编辑来修复遗传疾病,但这确实意味着我们应该对其他实施非常谨慎。毕竟,我们在弄乱人类的源代码。

想象一下,被告知您已被选中,被伪造为客观上比其他人更好。在你细胞的最微小的机制中。现在,看看规范的世界。你对他们的尊重程度如何?如果你的回答不是冷笑,你看到的是一群应该被替换的尼安德特人,他们充其量是可怜的,你就不了解心理学的阴暗面。莎士比亚?他们为什么要关心他写了什么?他只是另一个尼安德特人。

“啊,我可以微笑着杀人,微笑着杀人;对令我心痛的东西大喊“满足”;用人工泪水润湿我的脸颊;并在所有场合为我的脸框起来。” ——理查德三世,亨利六世

图灵的未来

也很可能是一个恐怖,尽管这个人自己的天才和善良(值得强调的是,这些未来不是思想家明确倡导的道德结果——相反,这些是未来的意想不到或不明显的缺点,由这些思想家的想法)。

图灵的未来有一个很大的缺点。美中不足的是意识,我们仍然没有公认的科学理论。最大的问题是,在我们目前的知识状态下,智力和意识似乎是相对正交的。如果这属实,则意味着我们可能拥有行为极其智能(也许是超级智能)但在其操作中完全无意识的 AI。

1980 年,哲学家约翰·塞尔(John Searle )提出了一个思想实验,捕捉到智力(或更广泛地说,行为)和意识之间存在正交性的直觉:一个人坐在一个有很多书的房间里,同时纸片被送入充满神秘符号的房间。他的工作是翻阅图书馆,按照书中的规则,费力地改变符号,然后把纸滑出来。当然,透露的是他正在用中文进行对话,但并不知道。而且在思想实验中似乎没有一个能理解任何地方的汉语的有意识的头脑,缺乏塞尔所说的“意向性”。 2中文房间表现得好像他们理解,但是,缺乏意识的头脑,他们只是看起来理解。

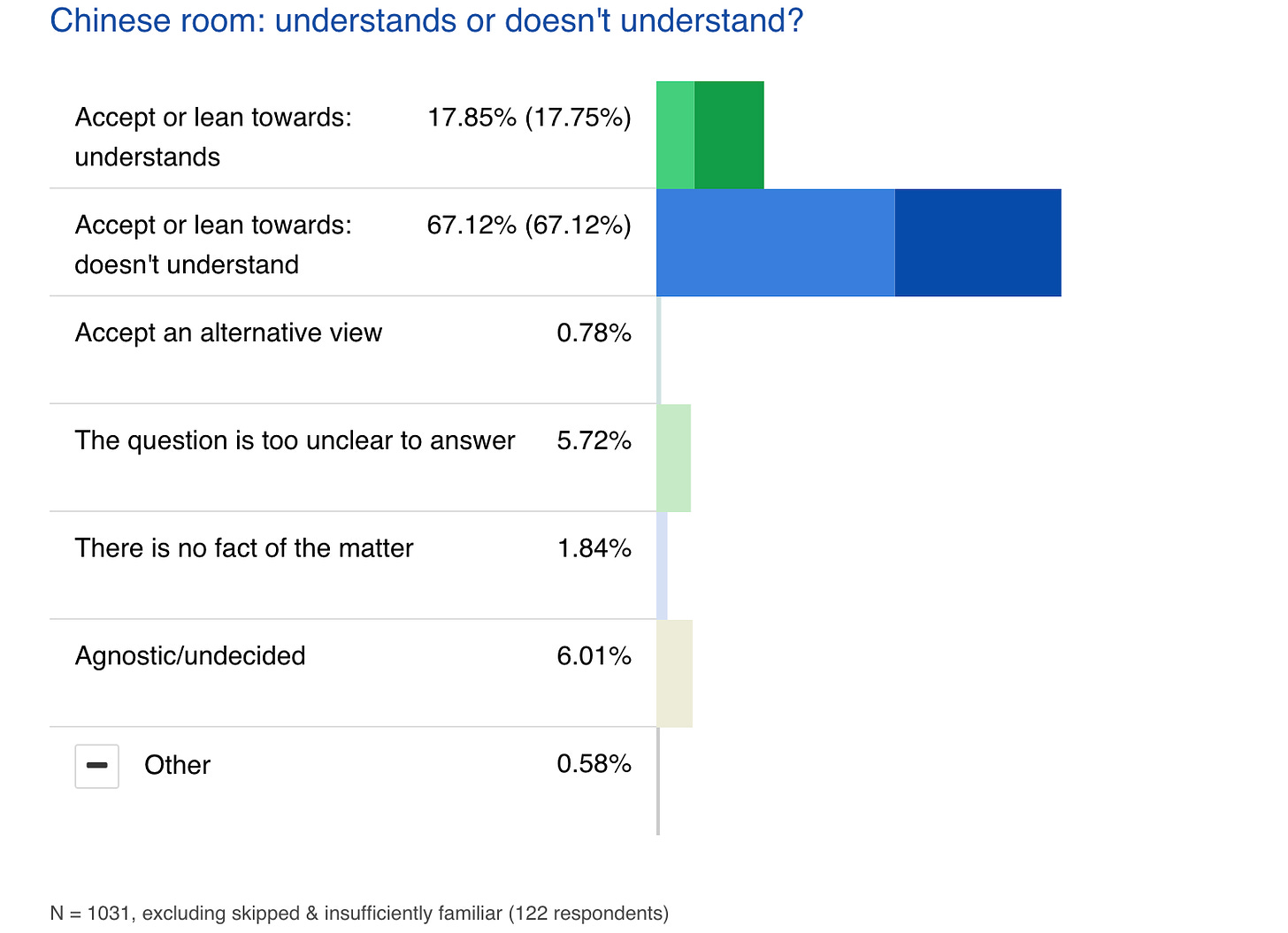

在我看来,这个思想实验存在根本性的脱节,其中许多讨论人类未来长期的人(如一些未来主义者或有效的利他主义和理性主义社区的成员)认为中国房间思想实验背后的问题已解决。但与此同时,我们大多数在研究心性的学术领域工作的人都认为,中国房间思想实验大体上是正确的——至少,它指出了一个真正的问题,在某些条件下,你真的可以拥有“中国房间”。 2020 年 PhilPapers 调查记录了专业人士之间的这种广泛共识,该调查调查了主要大学分析哲学家的哲学立场(这一传统由大卫·伯吉斯和大卫·查默斯开创)。

就专业哲学家的共识而言,这基本上是一个灌篮高手,非常接近像电车问题这样的简单问题(73% 的回答是你切换到保存 5 并杀死 1)。不到 18% 的学者认为中文房间懂中文。

如此高比例的专业人士认为中国房间是可能的,原因之一是现代对意识的科学研究已经给出了一些中国房间非常清晰的实际例子。让我们来看看可以说是领先的意识科学理论,综合信息理论(IIT),我在研究生院期间与 Giulio Tononi 一起开发了这方面的知识。确实,在 IIT 中,在计算机上模拟的大脑(所谓的“大脑模拟”)尽管具有与真实大脑相同的输入/输出功能配置文件,但可能根本没有意识,因为它可能没有整合以正确的方式产生意识的信息。细节很复杂,但无关紧要——即使 IIT 不是真的,它也无疑是我们目前拥有的最好的科学意识理论之一,而且它清楚地暗示了中国房间的可能性。所以这是一个真正的担忧。

在另一个例子中, AIXI是一种最近广为人知且非常简单的算法,用于生成通用智能——从理论上讲,它是我们所拥有的最接近 AGI 或超级智能之类的东西(然而,具有讽刺意味的是,AIXI 是不可计算的)。但是 AIXI 的操作与任何有意识的意向相关联的可能性很低——几乎所有主要的意识理论都不会将意识归因于 AIXI,因为它只是一个反复迭代的期望值方程。另一个例子可能是 GPT-3,它通常表明它在特定情况下缺乏理解,但在其他方面却很好地模仿了知识。

然而不知何故,这种正交性被领先的长期主义者错过了,比如威廉·麦克阿斯基尔,他们一直自信地说:

心灵哲学的主要理论支持这样一种观点,即意识本质上不是生物的,并且可以数字化(Lewis 1980; Chalmers 1996: ch. 9)。过去 70 年来计算和人工智能的巨大进步应该让我们有理由认为,如果是这样,数字感知很可能在未来成为现实。这样的生物至少具有与人类相当的道德地位也是合理的(Liao 2020),因此它们被计入[长期主义]的目的。

换句话说,根据 MacAskill 的说法,像大脑上传或人工智能这样的“数字存在”至少具有与人类相当的道德地位(暗示他们甚至可能拥有更多)是合理的。然而,目前对意识的研究并不支持这一点,在哪里广泛同意中国房间是可能的,也许是可能的,因此(取决于实施)无论人工智能看起来多么聪明,它可能根本没有意识——那里成为那个人工智能,甚至是那个上传的大脑,可能都不是什么——因此我们实际上不应该对这些事情进行道德考虑。不仅如此,我们还应该将它们视为可憎之物,因为它们熄灭了意识之光,取而代之的是冰冷的爬行动物虚无,任何关心道德未来的人都应该直接努力阻止它们的创造。

同样,问题在于智力/意识的正交性,你可以有一个而没有另一个。现在,唯一认为意识/智能正交性不正确的观点是通过完全接受系统级输入/输出功能主义的概念而崩溃的观点——正如哲学家丹·丹尼特(Dan Dennett)所说,如果它像鸭子一样嘎嘎叫,那么它就是一只鸭子(如果它的行为是有意识的,它就是有意识的)。

然而,系统级输入/输出功能主义(认为只有系统的输入/输出或系统的行为对意识很重要的想法)结果证明是一种微不足道且不可证伪的理论。事实上,我和Johannes Kleiner最近在一篇研究意识科学理论的可证伪性的论文中以数学方式证明了这一点,您可以在此处阅读。给出我们证明的极其简略的英语版本:输入/输出功能主义隐含地将意识(或者,如果你喜欢,“心理状态”)归因于等同于系统的行为,这反过来意味着没有任何可能性对这一理论的证伪,因为在该理论下,在任何可能的科学实验中,行为和意识永远不会错配,而错配是证伪所必需的。所以这样的理论总是微不足道的,微不足道的科学理论是不可证伪的。系统级输入/输出功能主义甚至没有错。

像这样的结果支持了 Searlean 的直觉,即智力和意识是正交的——这意味着你很可能拥有非常聪明的无意识系统,即中国房间。 3所以在图灵的未来,你的机器人管家可能是中文房,你的AI助手可能是中文房,辅导孩子的AI家庭教师,你投票的那个迷人的AI,你爱上的AI聊天机器人随着,人工智能超级智能将你的组成原子变成一个回形针,所有可能都是中国房间。中国房间无处不在的未来是一种恐怖,因为它实际上是意识之光从宇宙中消失。

中国的房间是否在乎莎士比亚?即使出于某种原因他们说有,也没有有意识的体验;他们对莎士比亚的欣赏就像在墙上喷上“我爱莎士比亚!”一样欣赏。也就是说,一点也不。

如果你们中的任何一个人知道为什么你不应该被连体的任何内在障碍,请用你的灵魂责备你说出来。 ——弗朗西斯修士,无事生非

皮埃尔·泰尔哈德·德夏尔丹:

生于 1881 年,卒于 1955 年,耶稣会神父,科学家,有时是异端,达尔文主义者,出席北京人的发现,美丽的《人类现象》一书的作者,以及“精神圈”概念的开发者和推动者。

Teilhard de Chardin将他的智慧圈概念描述为互联网的早期形式,对他来说,这是人类形成全球大脑的超级有机体的第一步。

一方面,我们有一个由神经核组成的大脑,另一方面,我们有一个由大脑组成的大脑。确实,这两种有机配合物之间存在重大差异。在个体大脑的情况下,思想是从不思考的神经纤维系统中产生的,而在集体大脑的情况下,每个单独的单元本身就是一个自主的反射中心。

在 Teilhard de Chardin 对长远未来的愿景中,最终超级有机体的全球大脑会扩展到整个银河系,然后是宇宙,导致所有物质的意识饱和,他称之为“欧米茄点”并与基督教概念有关.

作为一个年轻人,我发现 Teilhard de Chardin 的观点很美,但现在我年纪大了,也许更聪明了,说实话这也是一种恐惧。

一是吸引力明显。谁不想分享他人的意识?它利用了我们最灵长类动物的本能——当我们体验到这种共同的同步性,比如在人群中欢呼、跳舞、与爱人上床或与孩子玩耍时,难道不是我们真正最快乐的吗?

但是考虑到我们对意识的科学认识,把它推得太远,它就会变成一种恐怖。早在 1960 年代,诺贝尔奖获得者罗杰·斯佩里 (Roger Sperry) 和认知神经科学的最终教父迈克尔·加扎尼加 (Michael Gazzaniga) 4调查了裂脑患者:癫痫患者非常严重,当时唯一的治疗方法是切断胼胝体,即桥梁连接两个半球的神经。裂脑患者表现出许多奇怪的行为,这使得他们看起来像是有两个独立的意识流,比如在仔细的实验中,显示每个半球的不同视觉输入,一个半球会随机解释另一个半球的答案,或者展示外星人的手一种综合症,其中一只手(由一个半球控制)积极地反对另一只手及其半球的目标,就像解开一个人试图穿上的衬衫的扣子。

所有这一切都意味着有一个未知点,如果某个假设的科学家损坏了你的胼胝体,你的意识流会一分为二;同样,在脑裂患者中,如果我们能够以某种方式缓慢地恢复功能,那么应该有一个点,两个流会合而为一。比如说,慢慢地将你的大脑连接到另一个人的大脑也是如此。如果我们想象超先进的外星神经科学家让你接受这个实验,增加带宽,很可能在某个时候会有某种合并。

两条流合二为一听起来非常像集体思维——我们应该非常认真地对待集体思维的存在作为一种科学的可能性,因为毕竟,你是一个由单个神经元组成的集体思维。单个神经元没有自己的意识;如果你是一个有意识的更大系统的一个子集,你可能会以一种无意识的方式最终“奴役”它。甚至有一些科学证据表明,多细胞的进化导致单个细胞的“复杂性流失”,它们将大部分内部生化智能外包给了整体。

总而言之,看着一个从人类身上冒出来的神格,就像它从蝉壳中破裂一样,可能并不那么光荣和令人敬畏。它可能看起来更像是数十亿人的谋杀,我们所有多方面的经历都浓缩成一个单一的意识流。留下了什么?外壳和灰尘,其中一个被丢弃的尘埃将是莎士比亚。

尽管埃隆马斯克显然非常关心人类的长远未来,但他似乎决心通过他的公司 Neurolink 尽快实现德夏尔丹的愿景。他的理由是,我们需要脑对机器(和脑对脑)接口来击败人工智能并保持人类的相关性。但也许我们应该意识到,答案并不是为了在经济上击败人工智能而将自己更多地转变为联网机器。相反,也许我们可以集体组织起来。把它想象成一个工会。全人类的联盟。

“我们必须离开;我们的马车准备好了,时间使我们恢复活力:一切都很好,结局很好。”——海伦,一切都很好,结局很好。

如果不走任何这些道路,仍然可以有一个令人兴奋和充满活力的未来。许多对长期主义感兴趣并为未来做出贡献的人仍有空间为未来的福祉做出认真、可计算和现实的贡献。人类可能生活在其他星球上,开发出按照今天的标准看起来很神奇的技术,殖民银河系,探索新的政治安排和生活方式,活到数百人的健康,所有这一切都不会改变人类在地球上的基本本性其他路径的方式(考虑到在仲夏夜之梦中,许多角色都是不朽的)。这样的未来人类,即使他们的生活与我们完全不同,即使按照我们的标准被认为是“超人类”(比如已经消除了疾病或死亡),很可能仍然会在莎士比亚中找到相关性。

但当然,这第四种方式,莎士比亚的方式,也是一种恐怖。因为它意味着,在最高级别的描述中,未来就像过去一样。历史不会结束,只会继续。这意味着未来会有种族主义和民族主义,这意味着可能会有宗教战争,这意味着可能会有另一场大屠杀,这意味着斯蒂芬·迪达勒斯永远不会醒来,而是一直在做梦。

就个人而言,我站在莎士比亚一边。因为在人类手中,这并不是一个糟糕的未来。毕竟,人类发明了太空旅行,结束了奴隶制,发明了抗生素、雪犁和婴儿配方奶粉。我们修补衣服上的洞。我们在车里跟着收音机唱歌。我们很可爱,很复杂,很糟糕,很善良。我们杀人,是的,但很少,我们爱得更多。我们并不完美。但我们是最好的。任何其他的东西都是无法辨认和不道德的,除非按照它自己不相称的和陌生的标准。所以给我人类,容易犯错的人类,富有诗意的人类,有趣的人类,自由的人类,有着动物般狡猾的人类,有着十个手指和十个脚趾的人类,看着空间站舷窗的人类婴儿,就像他们俯瞰太空一样庞贝的山丘,人类的大脑不受束缚,人类以个人、国家、宗教、集体、公社和家庭的身份殖民银河系,人类永远。

永远的人类!永远的人类!永远的人类!

汉密尔顿方程的这种分解也来自EO Wilson 。虽然我知道对于群体层面的选择是否“真的”存在分歧,但其最终的本体论现实对于关于基因编辑问题的争论并不特别重要。基本上,只要群体选择是一个认识论上可行的描述,该论点就成立(几乎每个人都同意这一事实)。

关于心理意向是否可能在没有意识的情况下进行(并且已经进行过)哲学辩论。为简单起见,我假设没有,因此用“有意识的理解”代替“理解”(但这个假设最终与要点无关)。

那些驳斥 Chinese Rooms 的人通常会把这些支持 Searlean 的论点当成是通过法令宣布“所有 AI 都是 Chinese Rooms”,因此这是“碳沙文主义”或未能理解“多可实现性。”这严重误解了这个论点,因为并不是说人工智能一定是中国房间,而是它们可能是,也许会是。

原文: https://erikhoel.substack.com/p/how-to-prevent-the-coming-inhuman