认知状况:低

进步社区的首要目标是加速进步。其中一部分涉及研究进展的投入;另一部分涉及倡导促进进步的政策。一些常见的政策建议包括:

-

解决住房供应问题

-

改善和增加研发支出

-

增加移民

-

废除过度监管,特别是在能源领域

所有这些都会非常好,我支持他们。与此同时,任何增加增长的尝试都会遇到一些不利因素:

-

美国和其他西方政府似乎很僵化,导致监管膨胀,并可能使变革变得困难

-

由于出生人数减少和移民人数减少,美国的人口增长正在崩溃。在大多数增长模式下,人是新想法的关键来源。

-

好主意(可能)越来越难找到。当我们采摘“唾手可得的果实”时,前沿的增长可能会变得更加困难,尽管显然这经常引起争论。

自里根政府执政以来,美国的平均增长率为 2.7%。过去 10 年更令人失望,不到 2%。一个成功的进步运动能够完成什么?将利率提高到2.5%?到 4%?

我应该强调,我钦佩进步倡导者目前所做的所有政策和研究。但通常我们从大停滞的框架中接近进步:我们曾经快速成长,然后在 1971 年左右发生了一些事情,现在我们成长缓慢。但我想知道我们是否也应该考虑不同的世界观,以了解我们与未来的关系。

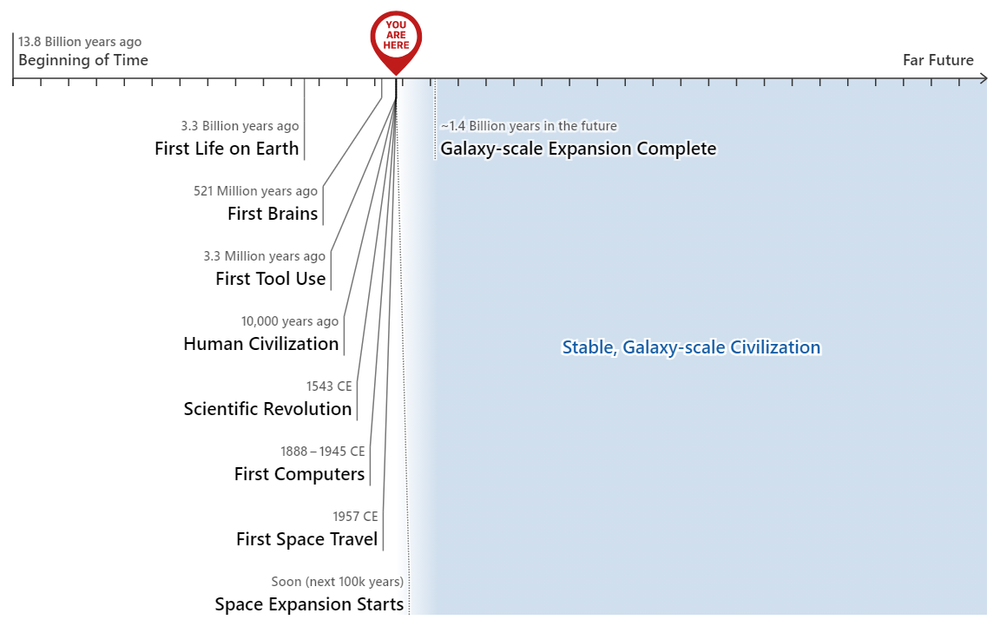

我对我们生活在最重要的世纪这一观点特别感兴趣。从这个角度来看,我们正在接近一个突破,可以克服人口下降的逆风和越来越难以寻找新想法的挑战:通过自动化生产知识。

Holden Karnofsky将此 AI 系统称为 PASTA:自动化科学和技术进步的过程。如果 PASTA 或类似的东西被创造出来,我们可能会进入一个快速增长的时期,这将很快迎来一个完全不同的未来。

这听起来有点牵强,但没有人反对它的毁灭性论据。科学听起来很难自动化,但人工智能已经没有像我们预期的那样进步;不像人们通常预期的那样,人工智能似乎正在从低技能劳动力慢慢上升到高技能劳动力,而不是像写作(GPT系统)和现在的插图(DALL-E)这样的创造性进步的速成课程。机器学习就是在没有精确指导的情况下通过反复试验进行训练。尽管目前的模型令人印象深刻,但它们甚至还没有人类大脑的 1% 大。但随着计算能力变得更便宜,这种情况将迅速改变(更多关于 AI 和 bioachnors 的信息)。

另外,什么时候进步的朋友反对科幻未来?

如果这看起来很有说服力,Karnofsky 在 PASTA 上的帖子(以及最重要的世纪系列的其余部分)更详细地讨论了这些场景。

那么我们是否应该建立 PASTA 并获得进步的回报?不——我们更可能应该非常担心。错位的人工智能存在严重风险,这可能对人类文明构成威胁,并且人类在银河系殖民时也可能存在风险,而没有对如何负责任地进行足够的道德反思。

所以我们陷入了一个有趣的境地:许多近似的增长目标看起来不错,但并没有改变世界。而“大赌注”可能是自杀式的任务。我不知道该怎么做。这意味着可能只是在 AI 对齐和政策方面工作。我认为至少值得我们对这些讨论更加好奇。

这里有一个很大的讽刺:尽管 EA 对 AI 轨迹持悲观态度,但他们看到了用卡诺夫斯基的话来说,“一个稳定的银河系文明”的可能性。如果在起飞开始时我们正在研究 NSF 的支出,那不是很傻吗?

原文: https://www.highmodernism.com/blog/pasta-and-progress-the-great-irony